Cómo Usar Caché para Acelerar Respuestas de APIs

Desarrollo Web

13 feb 2026

Guía práctica para implementar caché en APIs: tipos, encabezados HTTP, TTL, claves e invalidación para mejorar latencia y escalabilidad.

El caché en APIs permite reducir tiempos de respuesta al guardar temporalmente datos consultados con frecuencia. Esto evita acceder repetidamente a bases de datos o realizar cálculos costosos, mejorando la velocidad y eficiencia del sistema. Cuando se implementa correctamente, el caché puede disminuir tiempos de respuesta de más de 100 ms a milisegundos y reducir la carga en servidores hasta 10 o 100 veces.

Claves rápidas para usar caché en APIs:

Ventajas: Acelera respuestas, reduce costes y mejora la escalabilidad.

Cuándo usarlo: Datos que cambian poco, como catálogos de productos o contenido estático.

Tipos de caché:

Configuración clave: Usar encabezados HTTP como

Cache-Control, claves únicas y tiempos de expiración (TTL).

Optimizar el caché no solo mejora la experiencia del usuario, sino que también permite manejar grandes volúmenes de tráfico sin incrementar recursos. Sigue leyendo para aprender cómo configurarlo y medir su rendimiento.

REST API Caching Strategies Every Developer Must Know

Principales Métodos de Caché

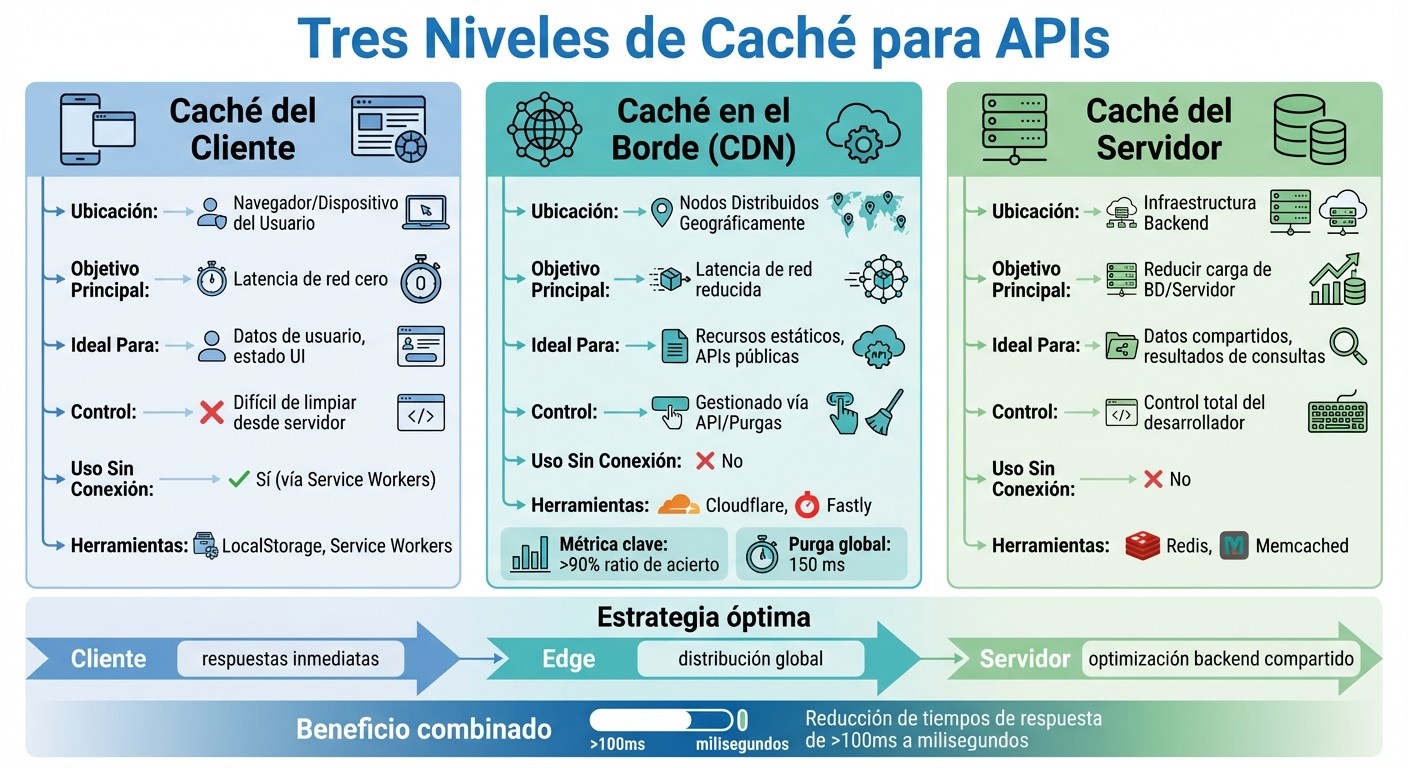

Comparación de métodos de caché para APIs: cliente, servidor y CDN

Implementar caché en APIs puede realizarse a través de tres métodos principales, cada uno con ventajas específicas dependiendo de dónde se almacenen los datos. Los sistemas más eficientes suelen combinar estos tres niveles: caché del lado del cliente para respuestas inmediatas en la interfaz, caché en el borde (edge) para distribución global y caché del lado del servidor para optimizar el backend compartido. Estos métodos trabajan en conjunto dentro de una estrategia global de caché, mejorando cada etapa del proceso de respuesta.

Caché del Lado del Servidor

Este enfoque guarda los datos directamente en el backend utilizando herramientas como Redis o Memcached. Almacenar resultados de consultas complejas o cálculos costosos reduce tanto la carga de la base de datos como el uso de la CPU. Redis destaca por su flexibilidad, soportando estructuras como listas, conjuntos y hashes, además de ofrecer persistencia. Por otro lado, Memcached se especializa en un modelo simple de clave-valor, priorizando la velocidad. Este tipo de caché es ideal para datos compartidos que requieren acceso frecuente, como estadísticas agregadas o temas populares.

Caché del Lado del Cliente

Aquí, los datos se almacenan directamente en el dispositivo del usuario, ya sea en el navegador o en una aplicación. Esto elimina solicitudes de red innecesarias, permitiendo tiempos de carga más rápidos y funcionalidad sin conexión. Es especialmente útil para información personalizada, como configuraciones de perfil o estados de la interfaz de usuario. Sin embargo, es crucial asegurarse de borrar este caché cuando el usuario cierra sesión, evitando posibles problemas de privacidad. Herramientas como LocalStorage o Service Workers facilitan la implementación de esta estrategia.

Caché en el Borde con CDNs

Las redes de distribución de contenido (CDN) almacenan datos en servidores "edge" ubicados cerca de los usuarios finales. Esto minimiza la latencia y protege al servidor de origen frente a picos de tráfico. Soluciones como Cloudflare y Fastly permiten purgar contenido global en tan solo 150 ms. Este enfoque es ideal para recursos estáticos (CSS, JavaScript, imágenes) y respuestas de APIs públicas dirigidas a una audiencia global. Para maximizar su eficacia, los desarrolladores deben apuntar a un ratio de acierto de caché superior al 90%, reduciendo así el tráfico al servidor de origen.

A continuación, se presenta una tabla comparativa de las características clave de cada método:

Cómo Configurar el Caché de APIs

Para optimizar el rendimiento de tu API, es importante configurar correctamente tres elementos clave: encabezados HTTP, claves únicas y tiempos de expiración. Estos componentes trabajan juntos para gestionar cómo se almacenan y actualizan los datos, mejorando tanto la velocidad como la eficiencia.

Configurar Encabezados HTTP de Caché

Los encabezados HTTP, especialmente Cache-Control, son esenciales para definir las reglas de almacenamiento. Algunas de las directivas más comunes incluyen:

public: Permite el almacenamiento en cachés compartidos, como CDNs.private: Restringe el caché al navegador del usuario.max-age=N: Indica el tiempo de frescura en segundos.no-store: Prohíbe cualquier almacenamiento de datos.

Para endpoints que manejan información sensible, como aquellos con autenticación, usa siempre Cache-Control: no-store para garantizar que las respuestas no se almacenen en ningún caché.

Además, los validadores como ETag (un hash único del contenido) y Last-Modified (una marca temporal) permiten que el servidor responda con un estado 304 Not Modified si los datos no han cambiado. Esto reduce significativamente el uso de ancho de banda.

"Tus encabezados son el contrato. Sé explícito y ganarás. Sé vago y cada intermediario se encogará de hombros y reenviará más tráfico a tu origen." - Accreditly

Para activos estáticos versionados, como archivos CSS o JS, configura max-age=31536000, immutable para evitar revalidaciones innecesarias. En APIs con alto tráfico, la directiva stale-while-revalidate=30 permite que los usuarios reciban respuestas ligeramente desactualizadas mientras el CDN obtiene nuevas en segundo plano, mejorando la experiencia del usuario.

Crear Claves de Caché

Las claves de caché son identificadores únicos que permiten localizar datos específicos. Estas claves se generan combinando el método HTTP y la URI objetivo, normalizando parámetros de consulta para evitar duplicados innecesarios. Por ejemplo, las solicitudes con ?a=1&b=2 y ?b=2&a=1 deben producir la misma clave.

El encabezado Vary es útil para personalizar respuestas según encabezados específicos, como Accept-Language o Accept-Encoding. Sin embargo, evita usar Vary: *, ya que desactiva efectivamente el caché.

Para datos privados, incluye identificadores únicos como el ID de usuario en la clave de caché. Esto asegura que cada usuario reciba únicamente sus datos. Además, utiliza claves versionadas con prefijos como v1:productos:123, lo que permite invalidar todo el caché al actualizar la versión.

Establecer TTL y Tiempos de Expiración

El TTL (Time-to-Live) define cuánto tiempo los datos permanecen en el caché antes de requerir una actualización. Esto se configura con max-age=N para todos los cachés o s-maxage=N para cachés compartidos como los CDNs.

Amazon API Gateway, por ejemplo, establece un TTL predeterminado de 300 segundos, con un máximo permitido de 3.600 segundos. Ajusta el TTL según el tipo de contenido:

Listados de productos: TTL medio (5-15 minutos), con invalidación al cambiar los datos.

Resultados de búsqueda: TTL corto (1-5 minutos), variando la clave según los parámetros de consulta.

Para equilibrar la carga entre el navegador y los CDNs, una configuración recomendada es s-maxage=120 para los CDNs y max-age=30 para los navegadores. Esto asegura que los usuarios vean datos más recientes mientras se reduce la carga en el servidor de origen. La directiva must-revalidate fuerza al caché a verificar con el servidor una vez que los datos caducan, priorizando la precisión.

Configurar correctamente estos elementos asegura que tu API sea rápida, eficiente y capaz de manejar grandes volúmenes de tráfico sin comprometer la precisión de los datos.

Gestionar Actualizaciones del Caché

Mantener el caché actualizado es clave para garantizar datos precisos sin sacrificar el rendimiento.

Limpiar el Caché Manualmente

Saber cómo y cuándo limpiar el caché manualmente es esencial para eliminar entradas obsoletas. Esto resulta útil cuando tienes certeza de que ciertos datos han cambiado. Por ejemplo, en Next.js, puedes usar herramientas como revalidatePath o revalidateTag para refrescar rutas o grupos de datos específicos. Si actualizas un producto y le asignas la etiqueta "productos", puedes limpiar todas las entradas relacionadas de una sola vez.

En el caso de cachés en CDN, es necesario eliminar objetos específicos antes de que caduque su TTL, asegurándote de que solo direcciones IP autorizadas puedan realizar estas acciones. Por otro lado, en el cliente, herramientas como Axios permiten eliminar entradas específicas, por ejemplo, con axios.storage.remove('id'). Esto es especialmente útil si recibes actualizaciones a través de WebSockets u otras fuentes externas.

Automatizar la Invalidación del Caché

Cuando los cambios son frecuentes, automatizar la invalidación del caché puede ahorrarte tiempo y esfuerzo. Esto elimina la necesidad de intervención manual al vincular las actualizaciones del caché a eventos como despliegues, cambios en la base de datos o modificaciones en tu CMS. Utilizar etiquetas de caché es una gran ayuda: asigna etiquetas como "usuario-123" o "productos" a tus datos, y cuando estos cambien, invalida automáticamente todas las entradas relacionadas.

Evita usar encabezados Vary demasiado amplios (como Vary: Cookie), ya que pueden generar demasiadas variantes del caché, reduciendo la tasa de aciertos .

Servir Datos Obsoletos Mientras se Actualizan

Otra técnica útil es servir datos desactualizados (o 'stale') mientras el caché se actualiza en segundo plano. La directiva stale-while-revalidate permite ofrecer respuestas rápidas con datos ligeramente antiguos mientras el sistema actualiza el caché, reduciendo la percepción de latencia.

"The stale-while-revalidate HTTP Cache-Control extension allows a cache to immediately return a stale response while it revalidates it in the background, thereby hiding latency (both in the network and on the server) from clients." - RFC 5861

Puedes combinar max-age con stale-while-revalidate para establecer periodos aceptables. Por ejemplo, max-age=600, stale-while-revalidate=600 proporciona hasta 20 minutos de datos válidos . Para mejorar la disponibilidad en caso de errores del servidor, añade stale-if-error, que entrega contenido antiguo si el servidor devuelve errores como 500, 502, 503 o 504 . Esta directiva es compatible desde Chrome 75 y Firefox 68.

Medir y Mejorar el Rendimiento del Caché

Una vez configurado y actualizado el caché, el siguiente paso es evaluar su rendimiento para garantizar una mejora real en la velocidad de respuesta. Herramientas como Apigee y AWS API Gateway facilitan este proceso al ofrecer paneles que muestran la tasa de aciertos del caché. Además, incluyen encabezados como X-Cache-Status o cf_cache_status, que indican valores como HIT, MISS o BYPASS.

Para obtener un análisis más detallado, es útil revisar los logs en busca de métricas como las proporciones de HIT, STALE y REVALIDATED. También es importante monitorear los percentiles p95 y p99 para identificar problemas que podrían pasar desapercibidos con promedios generales. Comparar los tiempos de respuesta con y sin caché es una forma directa de medir la reducción de latencia.

"Los promedios pueden ocultar problemas graves. En su lugar, rastrea percentiles de latencia como p95 y p99." - API7.ai

Antes de pasar a producción, es recomendable realizar pruebas de carga de al menos 10 minutos para comprobar el comportamiento del caché. Mientras tanto, durante el desarrollo, puedes añadir un encabezado con marca de tiempo (por ejemplo, cached-on) para verificar manualmente si el caché está funcionando correctamente.

Si notas que las tasas de acierto son bajas, podría deberse a encabezados Vary demasiado amplios, como Vary: User-Agent o Vary: Cookie, que generan un exceso de variantes. En función de las métricas obtenidas, ajusta los TTL según la frecuencia con la que cambian los datos y optimiza las claves del caché normalizando o ignorando parámetros innecesarios.

Evaluar el rendimiento del caché no solo confirma que la configuración inicial es efectiva, sino que también proporciona información valiosa para realizar ajustes que mantengan los tiempos de respuesta en niveles óptimos.

Conclusión

Incorporar caché en tus APIs no solo mejora la experiencia del usuario, sino que también optimiza los costes operativos. Como destacó Greg Linden, antiguo ingeniero de software de Amazon:

"Cada 100 milisegundos de latencia le cuestan a la empresa un 1% en ventas".

Este dato subraya la importancia de la velocidad como un factor clave para el éxito empresarial.

El caché es una herramienta poderosa para reducir la latencia, ya que permite servir datos desde la memoria de alta velocidad en lugar de realizar consultas costosas al backend. Por ejemplo, usar Redis para almacenar datos puede disminuir los tiempos de respuesta de 150 ms a menos de 50 ms. Esta mejora no solo acelera las respuestas, sino que también mantiene a los usuarios más conectados y satisfechos con tu aplicación.

Además de mejorar la velocidad, el caché es fundamental para gestionar picos de tráfico. Actúa como un amortiguador, permitiendo que tu infraestructura soporte mayores volúmenes sin necesidad de escalar proporcionalmente los recursos del servidor. Incluso en casos de fallos temporales del backend, el caché puede garantizar que los datos sigan disponibles, asegurando una experiencia continua para los usuarios.

Para aprovechar al máximo el caché, es esencial una monitorización constante y ajustes regulares. Apunta a un ratio de acierto superior al 90% para maximizar el rendimiento. Sin embargo, recuerda que siempre hay que equilibrar la frescura de los datos con la velocidad. Como afirma Lukas Niessen:

"El caché es a menudo la diferencia entre una aplicación ágil y una que los usuarios abandonan".

Implementar caché en diferentes niveles (cliente, servidor y edge), automatizar la invalidación mediante eventos y proteger adecuadamente la información sensible son pasos clave para crear APIs rápidas, escalables y seguras. Estas prácticas no solo reducen costes, sino que también aumentan la satisfacción del usuario.

Si estás buscando implementar estas optimizaciones, Niom Solutions puede ayudarte a diseñar soluciones digitales personalizadas que impulsen tu negocio al siguiente nivel.

FAQs

¿Qué endpoints no deberían cachearse nunca?

Los endpoints que no deben almacenarse en caché son aquellos que generan respuestas de error, como los códigos 4xx o 5xx. Esto asegura que no se sirvan datos incorrectos o desactualizados, lo que ayuda a mantener la precisión y la fiabilidad de las respuestas.

¿Cómo elijo el TTL ideal sin servir datos desactualizados?

Para seleccionar el TTL (Time to Live) adecuado, es clave encontrar un punto medio entre rendimiento, eficiencia y mantener el caché actualizado. Ajusta el TTL en función de la frecuencia con la que cambian los datos. Además, cuando sea posible, aprovecha sistemas de invalidación avanzados. Esto te ayudará a asegurar que los datos estén actualizados sin sacrificar la velocidad de respuesta.

¿Cómo evito fugas de datos al cachear respuestas por usuario?

Para proteger la información sensible al trabajar con cachés HTTP, es fundamental configurar los encabezados correctamente. Aquí tienes algunas recomendaciones clave:

Usa

Cache-Control: private: Este encabezado asegura que las respuestas solo se almacenen en cachés privados, como los del navegador del usuario, y no en cachés compartidos que puedan ser accesibles por otros usuarios.Incluye

Vary: Cookiesi es necesario: Si la respuesta depende de cookies o credenciales específicas, este encabezado ayuda a diferenciar las respuestas en función de esas variables, evitando que se mezclen datos entre usuarios.Evita almacenar tokens de autorización en cachés compartidos: Los tokens de autorización nunca deben guardarse en cachés de uso común, ya que esto podría exponer información sensible.

Configura mecanismos de expiración o invalidación: Asegúrate de establecer límites claros para la duración de los datos en caché. Esto reduce el riesgo de que información obsoleta o sensible permanezca accesible más tiempo del necesario.

Seguir estas prácticas ayuda a mantener la seguridad y privacidad de los datos al usar cachés HTTP, minimizando el riesgo de fugas de información.