Cómo Probar MVPs en Múltiples Navegadores y Dispositivos

Desarrollo Web

12 mar 2026

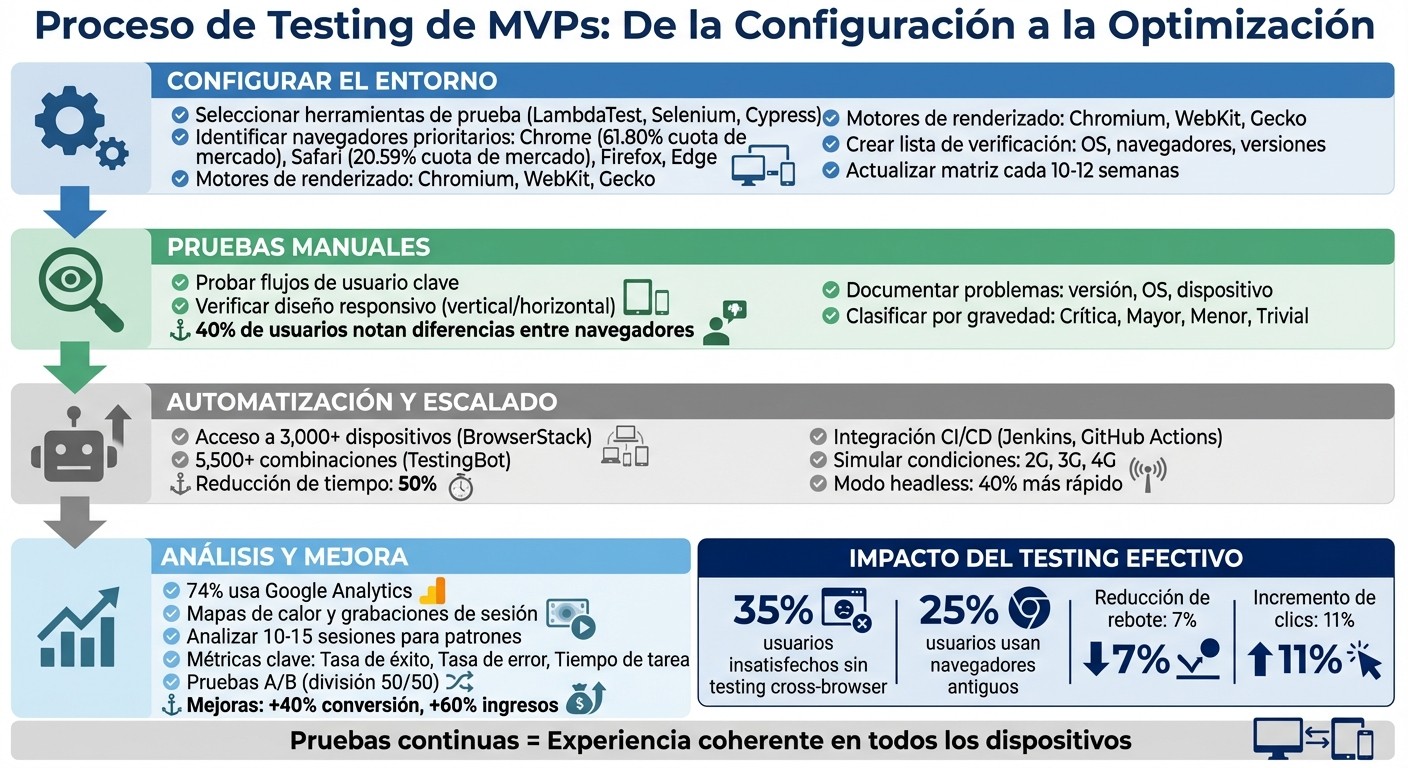

Guía práctica para testear un MVP en varios navegadores y dispositivos: configuración, pruebas manuales y automatizadas, análisis de usuarios y priorización de arreglos.

¿Por qué es clave probar un MVP en diferentes navegadores y dispositivos? Porque cada navegador y dispositivo puede interpretar el código de forma distinta, afectando la experiencia del usuario. Ignorar estas pruebas puede provocar errores visuales y funcionales que dañen la percepción de tu producto y aumenten los costos de corrección más adelante.

Puntos clave para garantizar la calidad del MVP:

Compatibilidad multiplataforma: Prueba en los motores de renderizado principales: Chromium (Chrome, Edge), WebKit (Safari) y Gecko (Firefox).

Dispositivos prioritarios: Usa datos de herramientas como Google Analytics para identificar los dispositivos y navegadores más usados por tu audiencia.

Pruebas manuales y automatizadas: Combina pruebas manuales para detectar problemas visuales y automatización para escalabilidad y rapidez.

Análisis de usuarios: Utiliza herramientas como Hotjar o Google Analytics para entender cómo interactúan los usuarios con tu MVP y detectar áreas de mejora.

Consejo práctico: Configura un entorno de pruebas claro, prioriza las correcciones según su impacto y realiza pruebas continuas para mantener la calidad del producto frente a actualizaciones tecnológicas.

El éxito de un MVP depende de su funcionalidad en todos los entornos. Identifica problemas temprano, ahorra costes y garantiza una experiencia sólida desde el inicio.

Proceso completo de testing de MVPs en múltiples navegadores y dispositivos

Cómo probar tu web en distintos dispositivos y velocidades de conexión con Chrome

Configurar el Entorno de Pruebas

Para evitar un proceso de testing desorganizado, es fundamental preparar cuidadosamente el entorno. Esto incluye seleccionar herramientas, dispositivos y navegadores prioritarios, además de estructurar un plan claro. Aquí te explicamos cómo hacerlo.

Seleccionar Herramientas y Plataformas de Prueba

Escoge plataformas que permitan probar en dispositivos reales, ya que esto ayuda a simular mejor las limitaciones de hardware y red. También es importante que sean compatibles con frameworks de automatización como Selenium, Cypress o Playwright, y que ofrezcan pruebas en paralelo para ahorrar tiempo.

Si no estás seguro de qué herramienta elegir, aprovecha los periodos de prueba gratuitos para comprobar su integración con tu flujo de trabajo. Por ejemplo, LambdaTest tiene planes desde 25 €/mes, mientras que Selenium es gratuito, aunque requiere conocimientos técnicos y configuración de infraestructura.

Identificar Dispositivos y Navegadores Prioritarios

Analiza los datos de tu audiencia con herramientas como Google Analytics para identificar los dispositivos y navegadores más relevantes para tu negocio, especialmente aquellos que influyen directamente en las conversiones e ingresos. Es clave enfocarse en los tres motores de renderizado principales:

Chromium: Usado por navegadores como Chrome y Edge.

Gecko: El motor de Firefox.

WebKit: Base de Safari.

Cada motor interpreta el código de manera distinta, lo que puede afectar la experiencia del usuario. Además, establece versiones mínimas de soporte para evitar gastar recursos en tecnología obsoleta. Como los navegadores modernos se actualizan automáticamente cada 10–12 semanas, revisa y actualiza tu matriz de pruebas con la misma frecuencia.

Crear una Lista de Verificación de Pruebas

Una checklist bien estructurada es clave para no pasar por alto ningún detalle. Incluye combinaciones de sistemas operativos como Windows, macOS, iOS y Android, junto con navegadores y sus versiones. Asegúrate de probar elementos interactivos como botones, menús y formularios, verificando las validaciones y los mensajes de error.

Para una evaluación más completa, incorpora escenarios reales como diferentes condiciones de red (2G, 3G, 4G) y funciones basadas en la geolocalización del usuario. Automatiza las pruebas de regresión para ahorrar tiempo, pero reserva las pruebas manuales para evaluar la experiencia del usuario. Este enfoque equilibrado ayuda a garantizar que ningún aspecto crítico quede fuera del proceso de pruebas.

Pruebas Manuales en Diferentes Navegadores

Una vez que el entorno esté configurado, realiza pruebas manuales del MVP en los navegadores más utilizados. Aunque la automatización puede ahorrar tiempo, las pruebas manuales son esenciales para detectar problemas visuales o de navegación que los scripts suelen pasar por alto. Chrome, con una cuota de mercado del 61,80%, y Safari, con el 20,59%, son los navegadores que debes priorizar. Identificar fallos en esta etapa ayuda a mejorar la experiencia del usuario y reduce costes antes de ampliar el alcance del producto.

Probar Flujos de Usuario y Funciones Principales

Para evaluar cómo será la experiencia del usuario real, recorre manualmente los flujos clave del MVP en cada navegador. Esto incluye tareas como el registro de usuarios, inicio de sesión, envío de formularios y procesos de compra. Asegúrate de que los botones, validaciones y mensajes de error funcionen correctamente. Los elementos interactivos, como menús desplegables y modales, requieren especial atención, ya que su comportamiento puede variar dependiendo del motor de renderizado utilizado (Chromium, Gecko o WebKit).

Verificar el Diseño Responsivo

Redimensiona la ventana o utiliza emuladores (como los DevTools) para comprobar que el diseño del MVP se adapta correctamente a diferentes resoluciones. Prueba tanto en orientación vertical como horizontal, especialmente en dispositivos móviles. Dado que alrededor del 40% de los usuarios perciben diferencias en el rendimiento o la interfaz al cambiar de navegador, es crucial garantizar una experiencia visual consistente. Una vez que confirmes la adaptabilidad del diseño, céntrate en identificar errores específicos.

Identificar y Documentar Problemas Específicos del Navegador

Cuando encuentres un problema, documenta la versión del navegador, el sistema operativo y el dispositivo donde ocurrió. Detalla los pasos exactos para reproducir el error y utiliza capturas de pantalla o grabaciones de vídeo con anotaciones para ilustrarlo. Clasifica cada incidencia según su nivel de gravedad (crítica, mayor, menor o trivial) para priorizar las correcciones de acuerdo a su impacto en la experiencia del usuario. Aprovecha las herramientas de desarrollo integradas para inspeccionar el HTML/CSS, depurar JavaScript y analizar posibles problemas de rendimiento.

Uso de la Automatización para Escalar las Pruebas

Tras completar pruebas manuales detalladas, la automatización permite ampliar el alcance sin requerir más tiempo o esfuerzo. Las herramientas automatizadas ejecutan los mismos casos de prueba de forma constante, eliminando la necesidad de intervención humana y acelerando el proceso. Por ejemplo, BrowserStack proporciona acceso a más de 3.000 dispositivos y navegadores reales en la nube, mientras que TestingBot ofrece más de 5.500 combinaciones . Esto significa que puedes evaluar tu MVP en miles de configuraciones sin necesidad de gestionar hardware físico. A continuación, exploramos las ventajas específicas que ofrece la automatización.

Ventajas de las Pruebas Automatizadas

La automatización resulta especialmente útil en pruebas de regresión, ya que asegura que las nuevas actualizaciones no afecten las funcionalidades existentes . A diferencia de las pruebas manuales, los scripts automatizados pueden ejecutarse continuamente y en paralelo . Por ejemplo, TestingBot ha llevado a cabo más de 1.000 millones de pruebas para sus 180.000 usuarios activos. Además, algunas herramientas modernas incluyen agentes basados en IA que generan scripts de prueba a partir de descripciones en lenguaje natural, reduciendo la necesidad de escribir código manualmente. Para equipos con conocimientos técnicos limitados, opciones como TestComplete o Katalon Studio ofrecen funciones de "grabar y reproducir", simplificando la creación de pruebas automatizadas.

Integración de Pruebas Continuas en los Flujos de Desarrollo

Un beneficio clave de la automatización es su integración en los flujos de trabajo de desarrollo. Al conectar herramientas de automatización con pipelines de integración continua como Jenkins, GitHub Actions, GitLab o CircleCI, las pruebas se ejecutan automáticamente con cada commit, detectando errores antes de que lleguen a producción. También puedes usar túneles seguros, como TestingBot Tunnel o BrowserStack Local, para probar versiones del MVP alojadas en servidores locales o entornos de staging. Configurar hooks de prueba, como before, after, beforeEach y afterEach, permite establecer precondiciones - como limpiar cookies - y restablecer el estado de la aplicación entre pruebas. Este enfoque de "shift-left testing" ayuda a identificar problemas en etapas tempranas del desarrollo, lo que reduce costes a largo plazo .

Simulación de Condiciones Complejas

Las herramientas de automatización también son ideales para replicar escenarios que serían difíciles de simular manualmente. Por ejemplo, puedes probar el rendimiento del MVP bajo velocidades de red lentas (2G, 3G, 4G) para garantizar su funcionalidad en condiciones de conexión deficientes . Además, puedes configurar geolocalizaciones, orientaciones de dispositivo y cargas de tráfico elevadas para evaluar cómo responde la aplicación bajo estrés. Es recomendable configurar scripts que capturen capturas de pantalla o grabaciones de vídeo durante las pruebas, facilitando así la depuración y el intercambio de resultados con el equipo . Finalmente, prioriza las pruebas basándote en datos analíticos: identifica los navegadores y dispositivos más usados por tu audiencia y enfócate en esas configuraciones .

Análisis del Comportamiento del Usuario Tras las Pruebas

Una vez validados los aspectos técnicos, el siguiente paso es entender cómo interactúan los usuarios con el MVP. Después del testing técnico, es crucial analizar las interacciones reales utilizando herramientas analíticas que midan tanto métricas cuantitativas como comportamientos específicos. Mientras que herramientas como Google Analytics (GA4) proporcionan datos sobre conversiones o tasas de rebote, plataformas como Hotjar o Contentsquare desvelan el "por qué" detrás de esas métricas, mostrando cómo los usuarios interactúan con el producto. De hecho, un 74% de los profesionales usa Google Analytics como su principal herramienta, aunque antes del lanzamiento de GA4, muchos se sentían sobrepasados por la complejidad de estas plataformas.

Uso de Herramientas Analíticas para Comprender el Comportamiento

Las herramientas de análisis de comportamiento permiten registrar cada clic, movimiento y desplazamiento en dispositivos como móviles, tablets o escritorios, ofreciendo una visión detallada del recorrido del usuario. Estas plataformas incluyen funciones avanzadas para filtrar datos por dispositivo, navegador o sistema operativo, lo que facilita identificar y solucionar problemas específicos. Por ejemplo, segmentar sesiones por navegador puede revelar fallos en elementos que dependen de JavaScript en navegadores menos utilizados. Además, indicadores como los "rage clicks" (clics repetidos en un elemento no funcional) o los retrocesos rápidos pueden señalar problemas técnicos o de diseño.

"Google Analytics will only show you conversion metrics like exit and bounce rates without explaining why. Contentsquare Funnels, on the other hand, give you the data and provide an explanation." – Contentsquare Content Team

Mapas de Calor y Grabaciones de Sesión

Los mapas de calor ofrecen una representación visual del comportamiento de los usuarios mediante colores, ayudando a identificar si llegan al contenido clave o si se distraen con elementos no clicables en ciertos tamaños de pantalla. Herramientas como mapas de clics, desplazamientos y movimientos son útiles para detectar áreas problemáticas. Además, revisar entre 10 y 15 grabaciones de sesión suele ser suficiente para identificar patrones de comportamiento, como momentos de duda o confusión. Combinar estos datos agregados (mapas de calor) con el análisis individual (grabaciones) permite determinar si un problema puntual es, en realidad, una tendencia generalizada. Por ejemplo, Hotjar ofrece un plan gratuito que permite analizar hasta 1.050 sesiones mensuales, ideal para obtener estos insights.

Métricas de Rendimiento y su Impacto

Tras implementar mejoras, es esencial medir su efectividad mediante métricas clave. La tasa de éxito indica qué porcentaje de usuarios completó una tarea específica, mientras que la tasa de error muestra cuántos se enfrentaron al mismo problema recurrente. El tiempo que los usuarios tardan en completar una tarea también puede revelar fricciones o confusiones en el diseño. Además, los datos respaldan el impacto positivo de los mapas de calor: resolver puntos de fricción puede aumentar las tasas de conversión hasta un 40%, y rediseñar secciones de páginas de destino basándose en datos de desplazamiento ha generado incrementos de ingresos de hasta un 60%. Incluso pequeñas correcciones basadas en estos análisis han ayudado a reducir las tasas de rebote en un 7% y a incrementar los clics en un 11%. Este tipo de análisis guía las futuras iteraciones del producto, asegurando una experiencia más fluida para los usuarios.

Mejora del MVP Basándose en los Resultados de las Pruebas

Tras realizar pruebas exhaustivas y analizar el comportamiento de los usuarios, el siguiente paso es optimizar el MVP enfocándose en las correcciones que realmente mejoren la experiencia. Sin una estrategia clara, es fácil perder tiempo en detalles menores mientras se ignoran problemas críticos. Por ejemplo, si no se realizan pruebas entre navegadores, las empresas podrían dejar insatisfechos a más del 35% de sus usuarios.

Clasificación de Correcciones por Impacto

Con los datos en mano, el primer paso es priorizar las correcciones según su impacto en la experiencia del usuario. Clasifica los problemas en cuatro categorías: Críticos, Mayores, Menores y Triviales. Arreglar un fallo en el proceso de pago, por ejemplo, debe tener prioridad sobre un desajuste visual menor.

La documentación existente y los datos analíticos son clave para esta clasificación. Por ejemplo, si el 61,80% de los usuarios usa Chrome y la mayoría accede desde dispositivos móviles, los problemas en Safari (20,59%) también podrían necesitar atención inmediata. Además, alrededor del 25% de los usuarios sigue utilizando navegadores antiguos, lo que hace que la compatibilidad hacia atrás sea un factor importante. También se estima que el 40% de las personas nota diferencias en rendimiento o diseño entre navegadores.

El uso de herramientas como monitorización de usuarios reales (RUM) permite identificar qué errores específicos de navegador causan más fricción o abandonos.

Uso de Pruebas A/B para Validar Cambios

Antes de aplicar cualquier cambio de forma definitiva, las pruebas A/B son ideales para validar hipótesis con usuarios reales. Define un objetivo claro, como aumentar conversiones o reducir rebotes, y plantea una hipótesis específica. Por ejemplo, podrías suponer que fijar el botón de llamada a la acción (CTA) incrementará los clics.

Crea una Variante B que modifique solo un elemento respecto a la Variante A, para que cualquier mejora en el rendimiento sea fácilmente atribuible al cambio. Ambas versiones deben ejecutarse simultáneamente y dividir el tráfico de forma equitativa (50/50) para evitar sesgos externos. Hacer pruebas en diferentes semanas podría distorsionar los resultados debido a factores estacionales.

Un caso práctico: mover un botón CTA a una posición fija en el viewport aumentó la tasa de clics del 17% al 22%. Mantén las pruebas hasta alcanzar una muestra estadísticamente significativa. Además, segmentar los resultados por dispositivo (móvil o escritorio) y tipo de usuario (nuevo o recurrente) puede ofrecer información más detallada sobre el comportamiento.

Repruebas y Monitorización Tras las Actualizaciones

Una vez implementadas las mejoras, es fundamental realizar repruebas para evitar regresiones. Esto asegura que las nuevas actualizaciones no afecten funcionalidades que ya estaban operativas. Dado que los navegadores y sistemas operativos se actualizan constantemente, un testing continuo es esencial para mantener la compatibilidad.

Es importante destacar que los emuladores no siempre reflejan las limitaciones reales de hardware, latencia o interacciones físicas como gestos táctiles o consumo de batería. Por eso, realizar pruebas de regresión periódicas tras cada actualización ayuda a garantizar que el nuevo código no introduzca errores en áreas previamente estables del MVP. Además, con Google priorizando la indexación mobile-first, cualquier fallo que afecte la experiencia móvil podría dañar la visibilidad en buscadores y aumentar las tasas de abandono.

En Niom Solutions, estas estrategias están integradas en el desarrollo para garantizar que los MVPs se mantengan optimizados, ofreciendo una experiencia fluida y constante en todos los navegadores y dispositivos.

Conclusión

Probar un MVP en diversos navegadores y dispositivos no es un lujo, es una estrategia esencial para garantizar que el producto funcione correctamente antes de su lanzamiento. En esta guía, hemos recorrido desde cómo configurar un entorno de pruebas hasta cómo implementar mejoras basadas en datos reales. Cada paso - pruebas manuales, automatización y análisis del comportamiento del usuario - contribuye a ofrecer una experiencia coherente y sólida, fortaleciendo la percepción de la marca.

Combinar diferentes métodos de prueba marca la diferencia para obtener resultados más fiables. Las pruebas automatizadas pueden reducir el tiempo de ejecución hasta un 50%, mientras que las manuales permiten detectar detalles específicos de la experiencia del usuario que las herramientas automáticas no siempre logran identificar. Además, realizar pruebas en dispositivos reales ayuda a evitar falsos positivos que los emuladores pueden generar, sobre todo en aspectos como interacciones táctiles o el rendimiento del hardware.

El ciclo de pruebas no termina con el lanzamiento del MVP. Dado que los navegadores y sistemas operativos se actualizan constantemente, es fundamental realizar pruebas periódicas para garantizar la compatibilidad. Integrar las pruebas en flujos de CI/CD permite detectar problemas antes de que lleguen a los usuarios finales, mientras que el uso del modo headless puede acelerar las pruebas hasta en un 40%.

Un MVP que funciona sin problemas en todos los entornos no solo mejora la experiencia del usuario, sino que también amplía el alcance del mercado y protege el posicionamiento SEO. En Niom Solutions, estas prácticas forman parte de cada proyecto, asegurando que los MVPs estén completamente optimizados y listos para destacar desde el primer día.

FAQs

¿Qué navegadores y versiones debo soportar en mi MVP?

Para ofrecer una experiencia consistente y garantizar la compatibilidad, es fundamental que tu MVP sea compatible con los navegadores más utilizados en sus versiones recientes: Chrome, Firefox, Safari y Edge. Esto asegura que los usuarios puedan acceder y utilizar tu producto sin problemas, independientemente de la plataforma que prefieran.

¿Cuándo usar pruebas manuales y cuándo automatizarlas?

Las pruebas manuales son perfectas para identificar errores complejos, evaluar problemas de usabilidad y validar cómo el usuario interactúa con el producto. Esto es especialmente útil en las primeras etapas del desarrollo o en casos donde se necesita un análisis más subjetivo y basado en el criterio humano.

Por otro lado, las pruebas automatizadas son ideales para tareas repetitivas y de gran volumen, como la verificación de compatibilidad en distintos navegadores y dispositivos. Estas pruebas destacan por su rapidez y su capacidad para abarcar diferentes entornos de manera eficiente.

¿Cómo priorizo los bugs según impacto y datos reales?

Para gestionar los bugs de manera eficiente, es útil clasificarlos según su nivel de criticidad:

P0 (Críticos): Estos son los errores más graves, aquellos que bloquean completamente el desarrollo o el uso del producto. Deben resolverse de inmediato.

P1 (Importantes): Aunque no bloquean el desarrollo, afectan funciones clave del sistema. Es crucial solucionarlos antes del lanzamiento.

P2/P3 (Menor impacto): Son problemas que tienen un impacto reducido en la experiencia del usuario o la funcionalidad general. Se pueden abordar según la disponibilidad de recursos y la prioridad general.

Este sistema de clasificación permite centrar los esfuerzos en los problemas que más afectan la experiencia del usuario y el funcionamiento esencial del producto, garantizando un desarrollo más eficiente y enfocado.